NVIDIA

Supercharges Hopper je iduća Nvidijina AI platforma

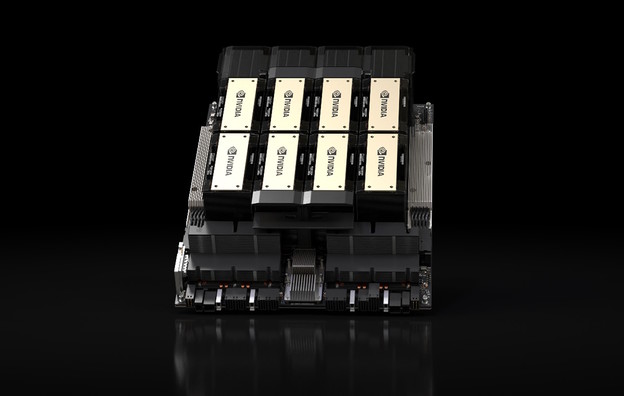

Nvidia je nadogradila svoju AI računalnu platformu s Nvidia HGX H200 sustavom.

Utemeljena na NVIDIAHopper arhitekturi, iduća Nvidijina AI platforma sadrži Nvidia H200 Tensor Core GPU s naprednom memorijom za rukovanje golemim količinama podataka za generativni AI i računalna opterećenja visokih performansi.

Nvidia H200 je prvi GPU koji nudi HBM3e, bržu, veću memoriju za ubrzanje generativnih AI i velikih jezičnih modela, dok unapređuje znanstveno računalstvo za HPC radna opterećenja.

Uz HBM3e, NVIDIA H200 isporučuje 141 GB memorije pri 4,8 TB/s, gotovo dvostruko veći kapacitet i 2,4 puta veću propusnost u usporedbi sa svojim prethodnikom, Nvidia A100.

Očekuje se da će se isporuka sustava pokretanih H200 vodećih svjetskih proizvođača poslužitelja i pružatelja usluga u oblaku početi isporučivati u drugom kvartalu 2024. godine.

"Uvođenje H200 dovest će do daljnjih skokova performansi, uključujući gotovo udvostručenje brzine zaključivanja na Llami 2, LLM-u od 70 milijardi parametara, u usporedbi s H100.

NVIDIA H200 bit će dostupan u NVIDIA HGX H200 poslužiteljskim pločama s četverostrukim i osmerostrukim konfiguracijama, koje su kompatibilne s hardverom i softverom HGX H100 sustava. Također je dostupan u NVIDIA GH200 Grace Hopper Superchipu s HBM3e, najavljenom u kolovozu.

S ovim opcijama, H200 se može implementirati u svim vrstama podatkovnih centara, uključujući on-line, cloud, hibridni-cloud i edge. NVIDIA-in globalni ekosustav proizvođača partnerskih poslužitelja, uključujući ASRock Rack, ASUS, Dell Technologies, Eviden, GIGABYTE, Hewlett Packard Enterprise, Ingrasys, Lenovo, QCT, Supermicro, Wistron i Wiwynn, mogu ažurirati svoje postojeće sustave s H200, navodi Nvidia u svojem priopćenju.

Nadalje, HGX H200 pruža više od 32 petaflopa FP8 računanja dubinskog učenja i 1,1 TB agregatne memorije visoke propusnosti za najviše performanse u generativnim AI i HPC aplikacijama.

Kada je uparen s Nvidia Grace CPU-ima s ultra-brzom NVLink-C2C interkonekcijom, H200 stvara GH200 Grace Hopper Superchip s HBM3e, integriranim modulom dizajniranim za opsluživanje velikih HPC i AI aplikacija.

Nvidia H200 platforma bit će dostupna od globalnih proizvođača sustava i pružatelja usluga u oblaku počevši od drugog kvartala 2024. godine."

Učitavam komentare ...